За BMS, BUS, индустриален, инструментален кабел.

Илон Мъск и екипът на xAI официално пуснаха най-новата версия на Grok, Grok3, по време на предаване на живо. Преди това събитие, значително количество свързана информация, съчетана с 24/7 рекламната шумотевица на Мъск, повишиха глобалните очаквания за Grok3 до безпрецедентни нива. Само преди седмица Мъск уверено заяви по време на предаване на живо, коментирайки DeepSeek R1: „xAI е на път да пусне по-добър модел на изкуствен интелект“. От данните, представени на живо, се твърди, че Grok3 е надминал всички настоящи масови модели по показатели за математика, наука и програмиране, като Мъск дори твърди, че Grok3 ще се използва за изчислителни задачи, свързани с мисиите на SpaceX до Марс, предричайки „пробиви на ниво Нобелова награда в рамките на три години“. В момента обаче това са само твърдения на Мъск. След старта тествах най-новата бета версия на Grok3 и зададох класическия подвеждащ въпрос за големи модели: „Кой е по-голям, 9.11 или 9.9?“ За съжаление, без никакви квалификации или маркировки, така нареченият най-умен Grok3 все още не можа да отговори правилно на този въпрос. Grok3 не успя да определи точно значението на въпроса.

Този тест бързо привлече значително внимание от много приятели и, по съвпадение, различни подобни тестове в чужбина показаха, че Grok3 се затруднява с основни въпроси по физика/математика като „Коя топка пада първа от Наклонената кула в Пиза?“. Поради това той беше хумористично етикетиран като „гений, нежелаещ да отговаря на прости въпроси“.

Grok3 е добър, но не е по-добър от R1 или o1-Pro.

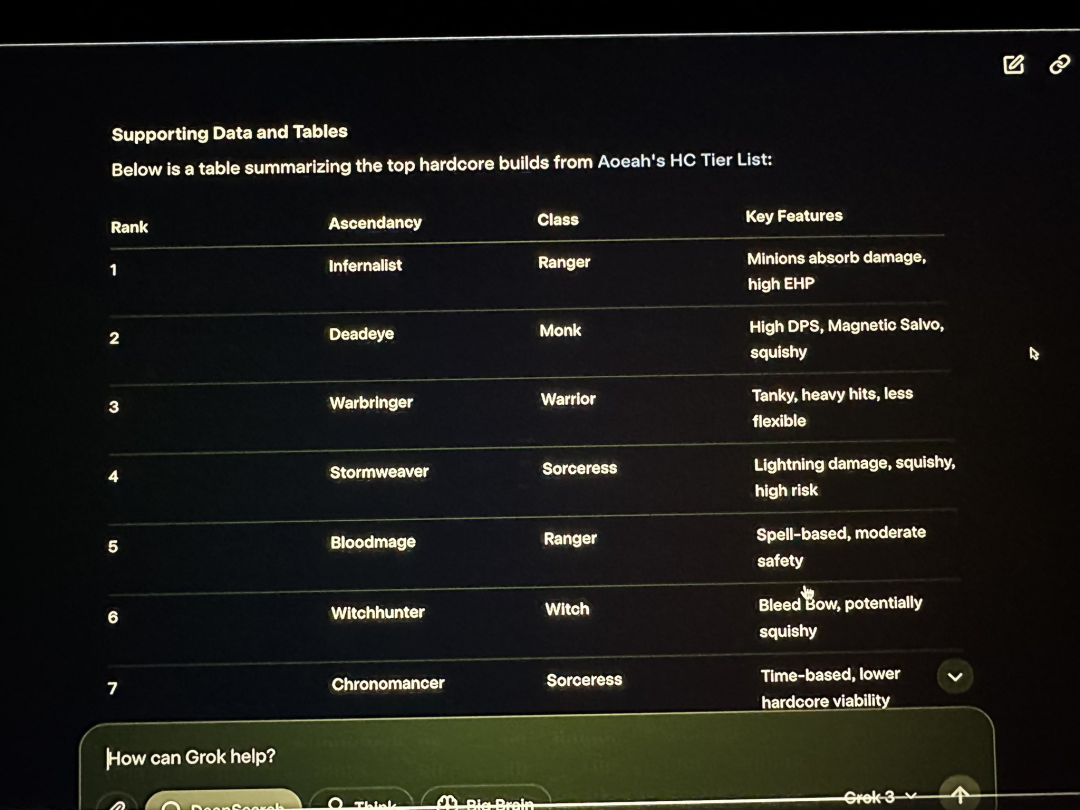

Grok3 претърпя „провали“ в много тестове за общопознаване на практика. По време на събитието за пускане на xAI, Мъск демонстрира използването на Grok3 за анализ на класовете герои и ефектите от играта Path of Exile 2, която той твърди, че играе често, но повечето от отговорите, предоставени от Grok3, бяха неправилни. Мъск по време на предаването на живо не забеляза този очевиден проблем.

Тази грешка не само предостави допълнителни доказателства на чуждестранните потребители в интернет да се подиграват на Мъск, задето е „намерил заместител“ в игрите, но и повдигна сериозни опасения относно надеждността на Grok3 в практически приложения. За такъв „гений“, независимо от действителните му възможности, надеждността му в изключително сложни сценарии на приложение, като например задачи за изследване на Марс, остава под въпрос.

В момента много тестери, получили достъп до Grok3 преди седмици, и тези, които тестваха възможностите на модела за няколко часа вчера, стигат до общо заключение: „Grok3 е добър, но не е по-добър от R1 или o1-Pro“.

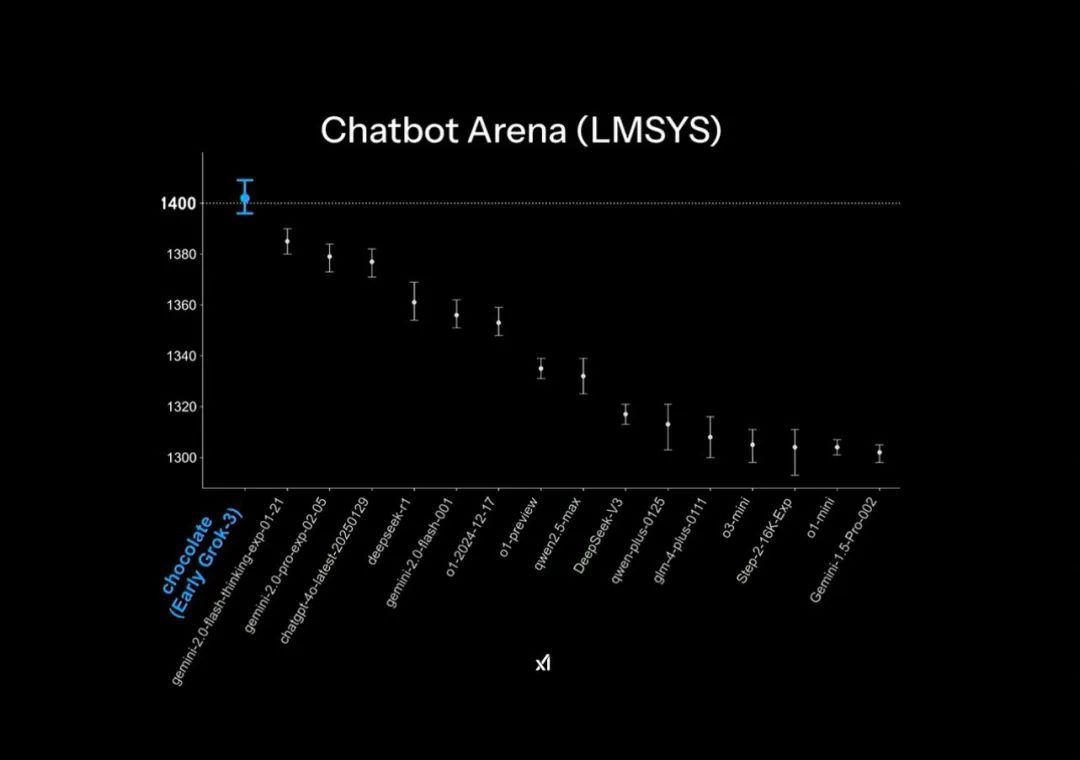

Критична перспектива върху „разрушаването на Nvidia“

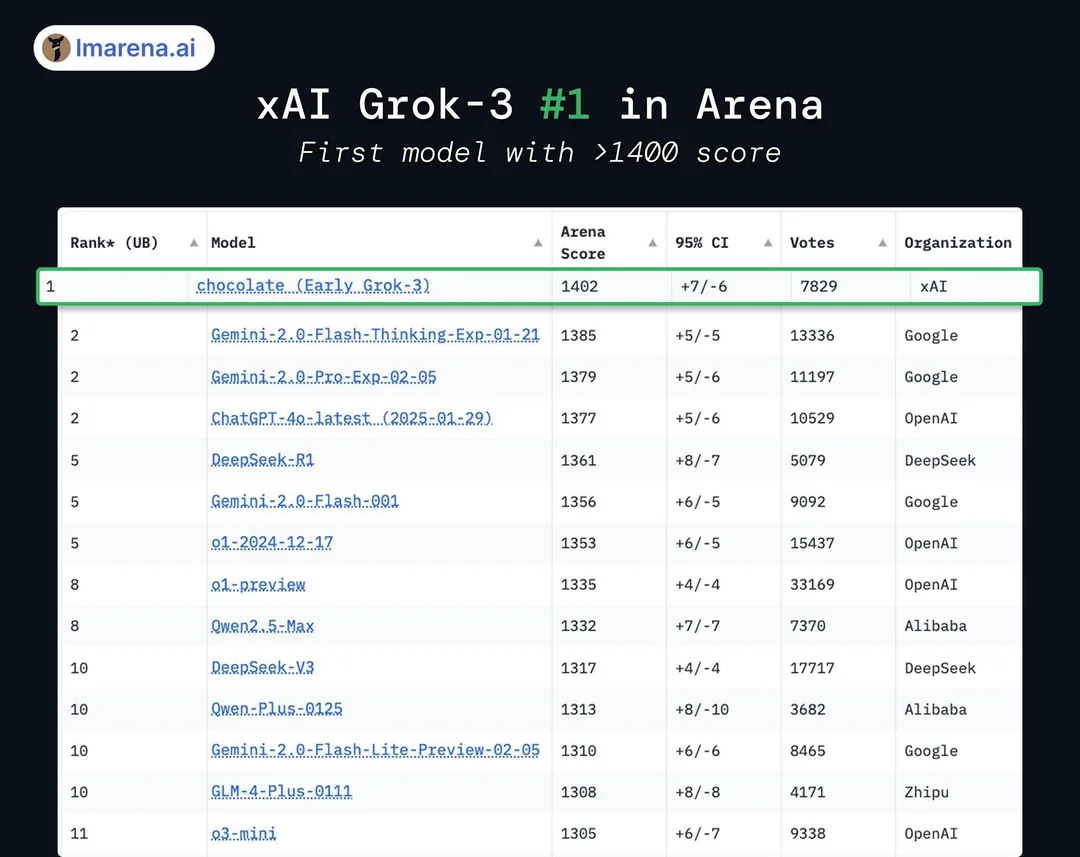

В официално представената презентация по време на пускането на пазара, Grok3 беше показан като „далеч напред“ в Chatbot Arena, но това умело използва графични техники: вертикалната ос на класацията изброяваше само резултати в диапазона от 1400-1300, което прави първоначалната разлика от 1% в резултатите от теста да изглежда изключително значителна в тази презентация.

В реалните резултати от оценяването на моделите, Grok3 е само с 1-2% пред DeepSeek R1 и GPT-4.0, което съответства на опита на много потребители в практически тестове, които не откриха „забележима разлика“. Grok3 превъзхожда своите наследници само с 1%-2%.

Въпреки че Grok3 е постигнал по-високи резултати от всички публично тествани модели, мнозина не приемат това насериозно: в края на краищата, xAI е бил критикуван за „манипулация на резултатите“ в ерата на Grok2. Тъй като класацията наказваше стила на дължина на отговорите, резултатите значително намаляха, което накара експерти от индустрията често да критикуват феномена „висок резултат, но ниска способност“.

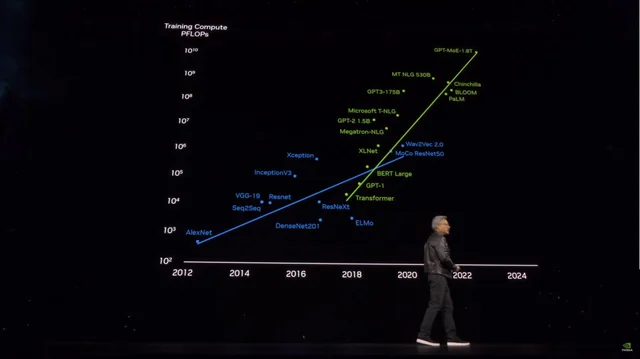

Независимо дали чрез „манипулация“ на класациите или дизайнерски трикове в илюстрациите, те разкриват манията на xAI и Мъск по идеята да „водещ“ по отношение на възможностите на моделите. Мъск плати висока цена за тези маржове: по време на старта той се похвали, че е използвал 200 000 H100 графични процесора (твърдейки, че е използвал „над 100 000“ по време на предаването на живо) и е постигнал общо време за обучение от 200 милиона часа. Това накара някои да повярват, че това представлява още един значителен плюс за индустрията на графичните процесори и да считат въздействието на DeepSeek върху сектора за „глупаво“. По-специално, някои смятат, че чистата изчислителна мощност ще бъде бъдещето на обучението на модели.

Някои потребители на интернет обаче сравниха консумацията на 2000 графични процесора H800 за два месеца, използвани за генериране на DeepSeek V3, като изчислиха, че действителната консумация на енергия за обучение на Grok3 е 263 пъти по-голяма от тази на V3. Разликата между DeepSeek V3, който отбеляза 1402 точки, и Grok3 е малко под 100 точки. След публикуването на тези данни мнозина бързо осъзнаха, че зад титлата на Grok3 като „най-силния в света“ се крие ясен ефект на незначителна полезност – логиката на по-големите модели, генериращи по-добра производителност, започна да показва намаляваща възвръщаемост.

Дори с „висок резултат, но ниска способност“, Grok2 разполагаше с огромни количества висококачествени данни от първа страна от платформата X (Twitter), за да подпомогне използването. При обучението на Grok3 обаче xAI естествено се сблъска с „тавана“, пред който OpenAI е изправен в момента – липсата на първокласни данни за обучение бързо разкрива пределната полезност на възможностите на модела.

Разработчиците на Grok3 и Мъск вероятно са първите, които разбират и идентифицират тези факти задълбочено, поради което Мъск непрекъснато споменава в социалните медии, че версията, която потребителите ползват сега, е „все още само бета версия“ и че „пълната версия ще бъде пусната през следващите месеци“. Мъск пое ролята на продуктов мениджър на Grok3, предлагайки на потребителите да предоставят обратна връзка по различни възникнали проблеми в секцията за коментари. Той може би е най-следваният продуктов мениджър на Земята.

И все пак, в рамките на един ден, производителността на Grok3 несъмнено предизвика тревога у онези, които се надяват да разчитат на „масивна изчислителна мощ“ за обучение на по-силни големи модели: въз основа на публично достъпна информация от Microsoft, GPT-4 на OpenAI има размер на параметрите от 1,8 трилиона параметъра, над десет пъти повече от GPT-3. Слуховете сочат, че размерът на параметрите на GPT-4.5 може да е дори по-голям.

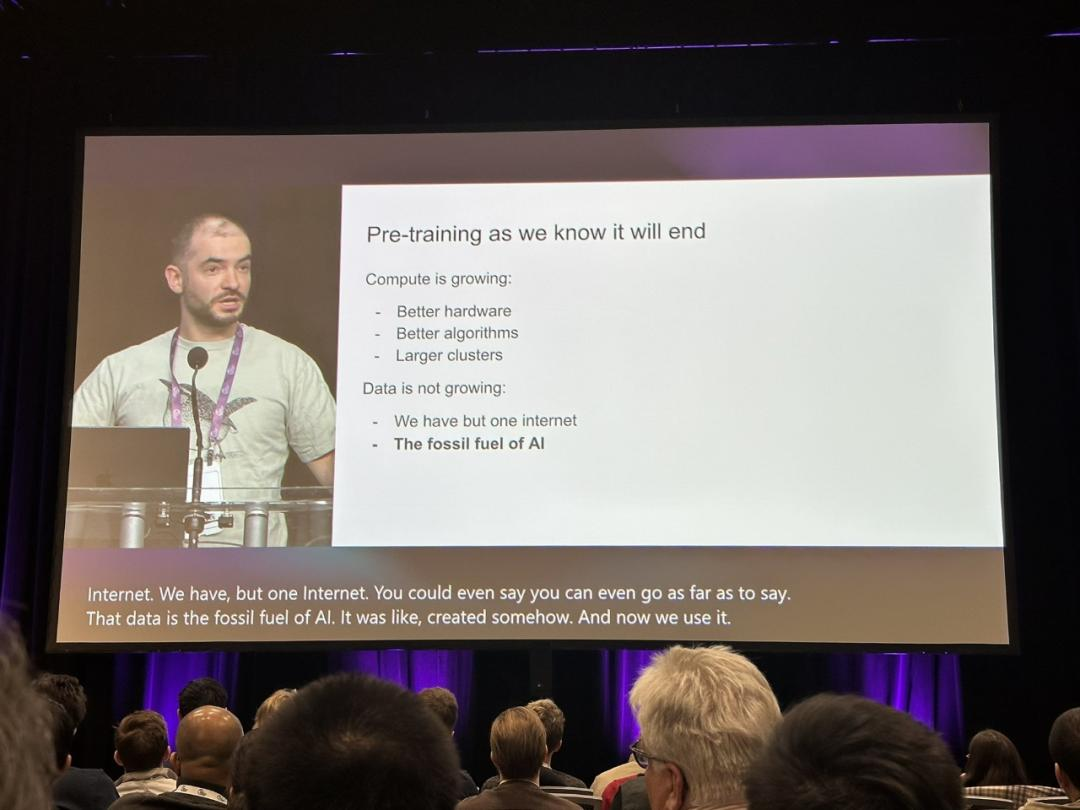

С нарастването на размерите на параметрите на модела, разходите за обучение също се покачват рязко. С присъствието на Grok3, претенденти като GPT-4.5 и други, които желаят да продължат да „харчат пари“, за да постигнат по-добра производителност на модела чрез размера на параметрите, трябва да вземат предвид тавана, който вече е ясно видим, и да обмислят как да го преодолеят. В този момент Иля Суцкевер, бивш главен учен в OpenAI, заяви преди това миналия декември: „Предварителното обучение, с което сме запознати, ще приключи“, което отново се появи в дискусиите, подтиквайки усилията да се намери истинският път за обучение на големи модели.

Гледната точка на Иля е алармирала индустрията. Той точно предвиди неизбежното изчерпване на достъпните нови данни, което ще доведе до ситуация, в която производителността не може да продължи да се подобрява чрез събиране на данни, оприличавайки го на изчерпването на изкопаемите горива. Той посочи, че „подобно на петрола, генерираното от човека съдържание в интернет е ограничен ресурс“. Според прогнозите на Суцкевер, следващото поколение модели, след предварително обучение, ще притежават „истинска автономност“ и способности за разсъждение, „подобни на човешкия мозък“.

За разлика от днешните предварително обучени модели, които разчитат предимно на съвпадение на съдържание (базирано на предварително обученото съдържание на модела), бъдещите системи с изкуствен интелект ще могат да се учат и да установяват методологии за решаване на проблеми по начин, подобен на „мисленето“ на човешкия мозък. Човек може да постигне фундаментални познания по дадена тема само с основна професионална литература, докато голям модел с изкуствен интелект изисква милиони точки от данни, за да постигне само най-основната ефикасност на начално ниво. Дори когато формулировката се промени леко, тези фундаментални въпроси може да не бъдат правилно разбрани, което илюстрира, че моделът не се е подобрил истински по отношение на интелигентността: основните, но нерешими въпроси, споменати в началото на статията, представляват ясен пример за това явление.

Заключение

Въпреки това, отвъд грубата сила, ако Grok3 наистина успее да разкрие на индустрията, че „предварително обучените модели наближават своя край“, това би имало значителни последици за областта.

Може би след като лудостта около Grok3 постепенно отшуми, ще станем свидетели на повече случаи като примера на Фей-Фей Ли за „настройване на високопроизводителни модели върху специфичен набор от данни само за $50“, в крайна сметка откривайки истинския път към AGI.

Контролни кабели

Структурна кабелна система

Мрежа и данни, оптичен кабел, пач корд, модули, лицева плоча

16-18 април 2024 г. Енергетично изложение за Близкия изток в Дубай

16-18 април 2024 г. Securika в Москва

9 май 2024 г. СЪБИТИЕ ЗА ПРЕДСТАВЯНЕ НА НОВИ ПРОДУКТИ И ТЕХНОЛОГИИ в Шанхай

22-25 октомври 2024 г. СИГУРНОСТ КИТАЙ в Пекин

19-20 ноември 2024 г. CONNECTED WORLD KSA

Време на публикуване: 19 февруари 2025 г.